AiHubMix

Site web ouvert-

Présentation de l'outil:Routeur API style OpenAI pour Gemini, Qwen; parallélisme illimité.

-

Date d'inclusion:2025-11-02

-

Réseaux sociaux et e-mails:

Informations sur l'outil

Qu’est-ce que AiHubMix

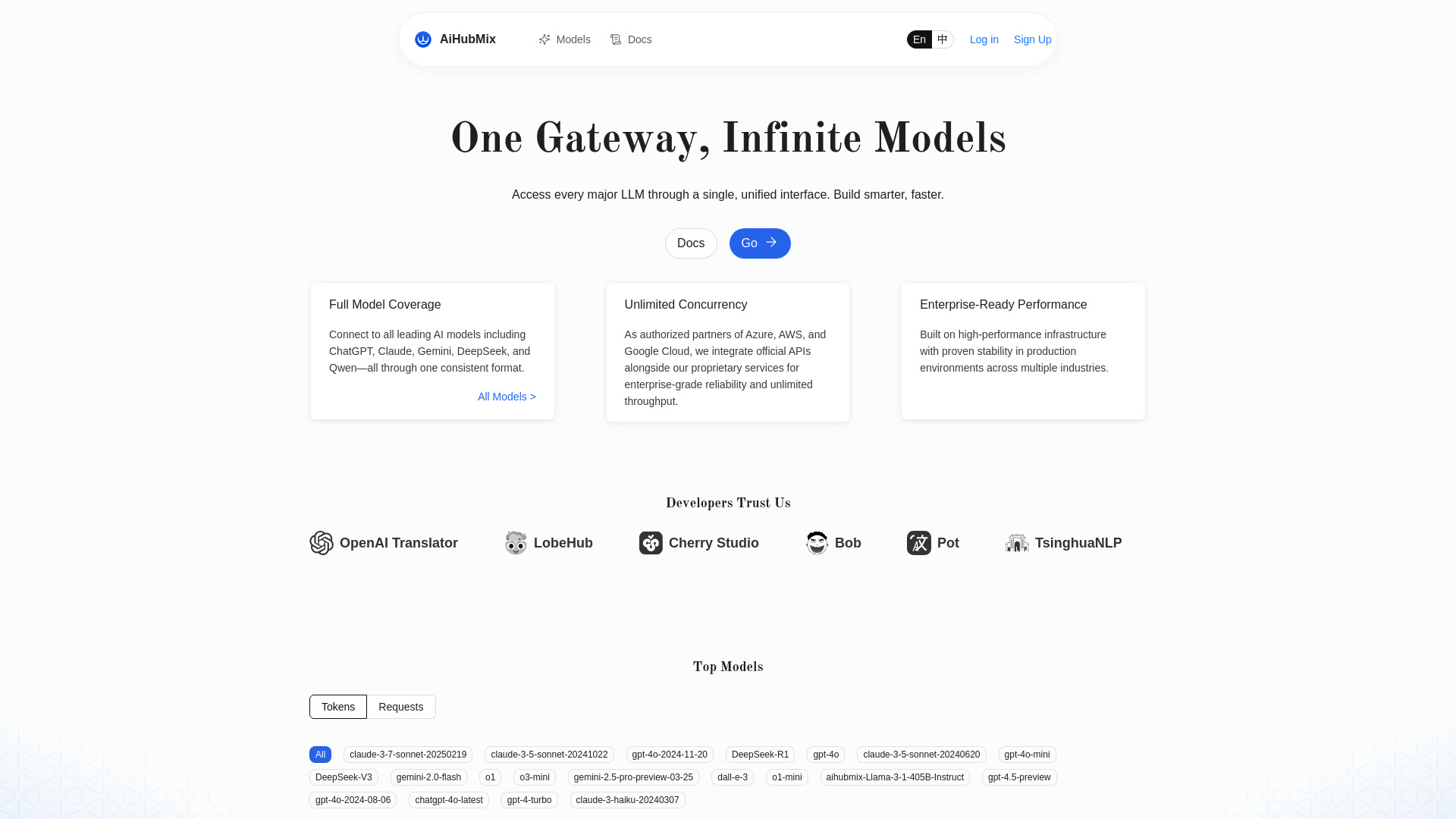

AiHubMix est un routeur d’API LLM et un proxy compatible avec l’API d’OpenAI qui agrège, via une passerelle unique, des modèles issus de plusieurs fournisseurs (OpenAI, Google Gemini, DeepSeek, Llama, Qwen, Claude, Moonshot, Cohere). En proposant un standard unifié pour l’appel des modèles, il simplifie l’intégration, réduit la complexité multi-fournisseurs et accélère la mise en production. L’outil suit les derniers modèles disponibles et offre une concurrence illimitée, ce qui favorise une montée en charge fluide et un développement plus efficace.

Fonctionnalités principales de AiHubMix

- API unifiée compatible OpenAI : conservez le même format de requêtes et de réponses pour appeler différents modèles sans réécrire votre code.

- Agrégation multi-fournisseurs : accès centralisé à des modèles OpenAI, Google Gemini, DeepSeek, Llama, Qwen, Claude, Moonshot et Cohere.

- Routage par modèle : sélectionnez simplement le modèle via le champ model et changez de fournisseur en minimisant les modifications.

- Prise en charge des derniers modèles : adoptez rapidement les sorties récentes sans remanier l’intégration.

- Concurrence illimitée : traitement de charges élevées et parallélisation massive pour les applications à grande échelle.

- Simplification de la maintenance : réduction de la dette technique liée aux SDK multiples et aux différences d’API.

- Flexibilité d’expérimentation : facilitez l’A/B testing et le benchmarking de modèles pour optimiser coût, qualité et latence.

À qui s’adresse AiHubMix

AiHubMix convient aux développeurs backend et full‑stack, aux équipes produit IA, aux startups et plateformes SaaS, aux intégrateurs système, ainsi qu’aux équipes data/ML souhaitant orchestrer plusieurs LLM via une interface unifiée. Il est particulièrement pertinent pour les applications de conversation, génération de contenu, outils de productivité, assistants de code, et tout service nécessitant une montée en charge rapide et une portabilité multi-fournisseurs.

Comment utiliser AiHubMix

- Définissez les modèles cibles et la stratégie de sélection (qualité, coût, latence, langue, domaine).

- Configurez l’URL de passerelle AiHubMix et conservez le format de l’API OpenAI déjà utilisé dans votre application.

- Spécifiez le model souhaité dans vos requêtes et envoyez vos prompts comme d’habitude.

- Testez les principaux flux (chat, complétion, génération) et comparez les réponses selon les fournisseurs.

- Déployez en production et ajustez la sélection des modèles en fonction des métriques de qualité et de coût.

Cas d’utilisation de AiHubMix

- Assistants conversationnels multilingues routant vers différents modèles selon la langue ou le registre.

- Génération de contenu à grande échelle (articles, descriptions produits) avec optimisation coût/performance.

- Systèmes de recherche augmentée (RAG) combinant plusieurs LLM selon le contexte ou le type de requête.

- Outils de développement (revue et explication de code) testant plusieurs modèles pour améliorer la précision.

- A/B testing, benchmarking et migrations rapides entre fournisseurs sans modifier l’architecture applicative.

Avantages et inconvénients de AiHubMix

Avantages :

- Interface unifiée réduisant la complexité multi-API et la maintenance.

- Compatibilité avec le standard OpenAI pour limiter les changements de code.

- Large choix de modèles (OpenAI, Google Gemini, DeepSeek, Llama, Qwen, Claude, Moonshot, Cohere).

- Concurrence illimitée et montée en charge facilitée.

- Adoption rapide des derniers modèles sans refactorisation majeure.

Inconvénients :

- Dépendance à une couche intermédiaire pouvant ajouter une légère latence.

- Hétérogénéité possible des comportements selon les fournisseurs et les versions de modèles.

- Fonctions très spécifiques à un fournisseur potentiellement non exposées de façon identique via l’interface unifiée.

- Nécessité d’évaluer la conformité et la gouvernance des données selon votre secteur.

Questions fréquentes sur AiHubMix

-

AiHubMix est-il compatible avec les SDK existants basés sur l’API d’OpenAI ?

Oui. L’outil adopte un standard d’appel unifié proche de l’API d’OpenAI, ce qui limite les changements à apporter au code.

-

Puis-je changer de fournisseur sans réécrire mon application ?

Oui. Il suffit en général de modifier la valeur du champ model pour cibler un autre fournisseur ou une autre version.

-

Quels modèles sont pris en charge ?

Parmi les principaux : OpenAI, Google Gemini, DeepSeek, Llama, Qwen, Claude, Moonshot et Cohere, avec suivi des modèles récents.

-

AiHubMix convient-il aux charges élevées ?

Oui, il prend en charge une concurrence illimitée, adaptée aux applications nécessitant un fort parallélisme.