- Trang chủ

- Công cụ Phát triển AI

- Zeabur

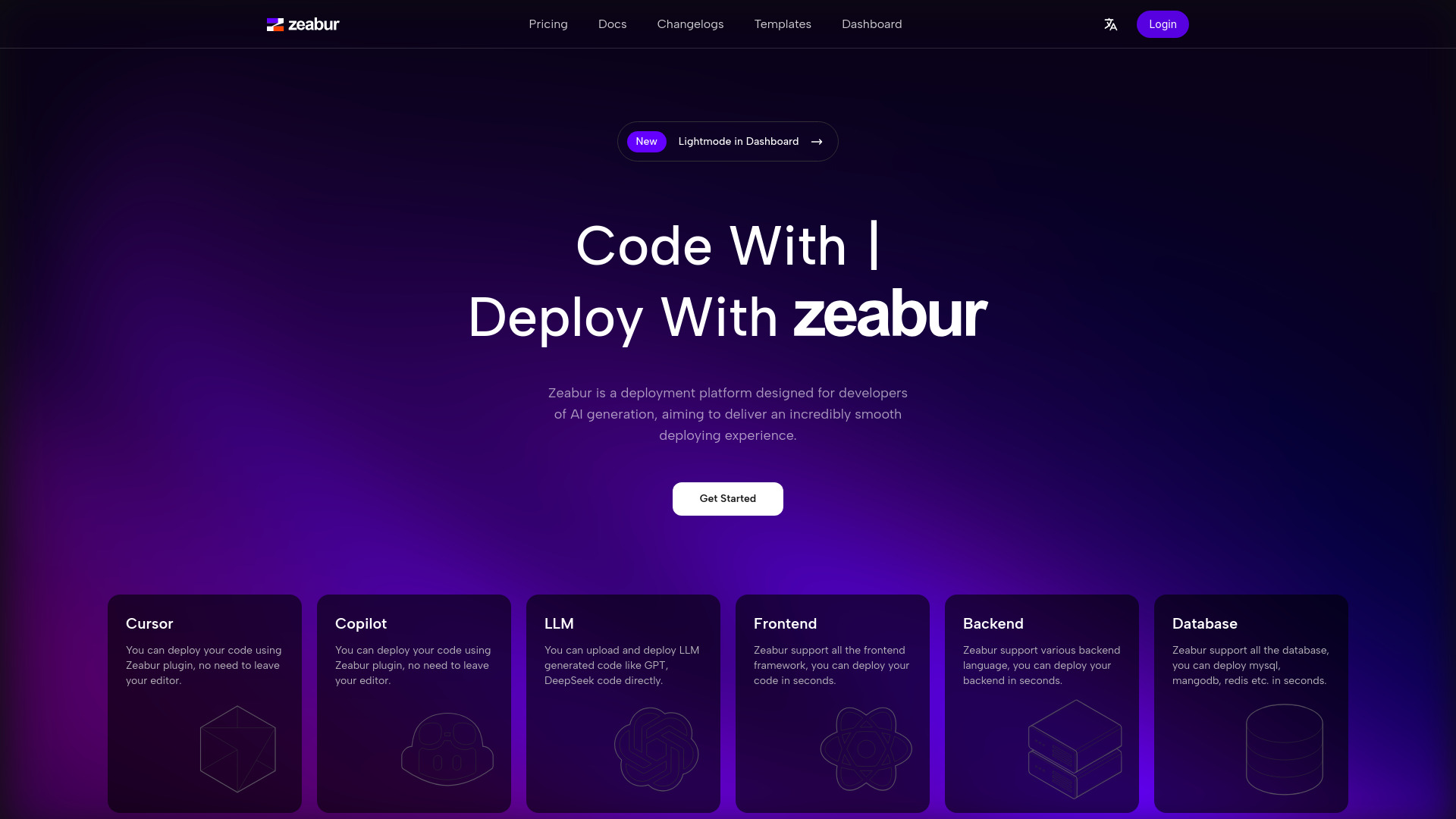

Zeabur

Mở trang web-

Giới thiệu công cụ:Zeabur AI triển khai ứng dụng AI nhanh, autoscale, CI/CD, trả theo dùng

-

Ngày thêm:2025-10-28

-

Mạng xã hội & Email:

Thông tin công cụ

Zeabur AI là gì?

Zeabur AI là nền tảng triển khai đám mây dành cho kỷ nguyên AI, giúp nhà phát triển đưa ứng dụng lên môi trường sản xuất nhanh, ổn định và tiết kiệm chi phí. Công cụ hỗ trợ nhiều ngôn ngữ backend, framework frontend và cơ sở dữ liệu, cho phép triển khai cả mã nguồn truyền thống lẫn mã do LLM tạo ra chỉ trong vài giây. Zeabur AI tích hợp phân tích mã tự động, gom nhóm dịch vụ, CI/CD, tự động mở rộng (auto-scaling), quản lý miền (domain), biến môi trường, tệp và bộ nhớ đối tượng. Với mô hình tính phí theo mức sử dụng (pay‑as‑you‑go), shared cluster, binding server và tùy chọn VPS, nền tảng tối ưu cho đội ngũ muốn rút ngắn thời gian đưa sản phẩm ra thị trường.

Các tính năng chính của Zeabur AI

- Tự động phân tích mã nguồn: Nhận diện ngăn xếp công nghệ, build và cấu hình runtime phù hợp.

- Triển khai đa nền tảng: Hỗ trợ nhiều ngôn ngữ backend, framework frontend và cơ sở dữ liệu.

- Triển khai mã do LLM tạo: Đưa prototype AI vào môi trường thực tế nhanh, giảm rủi ro cấu hình.

- Gom nhóm dịch vụ (service aggregation): Kết nối frontend, backend và DB thành một hệ thống đồng bộ.

- CI/CD tích hợp: Tự động build, test, deploy khi có thay đổi trên kho mã (Git).

- Tự động mở rộng: Scale theo tải để tối ưu hiệu năng và chi phí.

- Quản lý biến môi trường và bí mật: Thiết lập, phiên bản hóa, chia sẻ an toàn giữa dịch vụ.

- Quản lý domain và SSL: Gắn tên miền tùy chỉnh, chứng chỉ tự động.

- Bộ nhớ đối tượng và quản lý tệp: Lưu trữ asset, log, dữ liệu tĩnh thuận tiện.

- Chợ mẫu (template marketplace): Khởi tạo nhanh dự án phổ biến chỉ với vài click.

- Shared clusters, server binding, VPS hosting: Linh hoạt tài nguyên theo nhu cầu.

- Giám sát và log: Theo dõi trạng thái, cảnh báo, khắc phục sự cố kịp thời.

Đối tượng phù hợp với Zeabur AI

Zeabur AI phù hợp với startup, indie hacker, đội ngũ sản phẩm nhỏ cần go‑to‑market nhanh; kỹ sư AI/ML muốn triển khai dịch vụ model‑serving, chatbot, RAG; doanh nghiệp vừa và nhỏ cần hạ tầng PaaS linh hoạt; agency/dịch vụ phát triển web cần quy trình CI/CD chuẩn; nhóm giáo dục/hackathon cần môi trường triển khai đơn giản, chi phí tối ưu.

Cách sử dụng Zeabur AI

- Đăng ký tài khoản và tạo workspace dự án.

- Kết nối kho mã (GitHub/GitLab) hoặc upload mã nguồn/artefact.

- Để Zeabur AI tự động phân tích ngăn xếp và gợi ý cấu hình build/run.

- Chọn mẫu (template) phù hợp hoặc thiết lập dịch vụ thủ công.

- Cấu hình biến môi trường, bí mật, thông số build và runtime.

- Provision cơ sở dữ liệu/bộ nhớ đối tượng nếu cần và liên kết với dịch vụ.

- Chọn hạ tầng: shared cluster, binding server hoặc VPS; đặt khu vực triển khai.

- Bật CI/CD để tự động triển khai theo nhánh/tag; thiết lập auto-scaling.

- Gắn domain tùy chỉnh, bật SSL, cấu hình route và cân bằng tải.

- Triển khai, theo dõi log/metrics, tối ưu tài nguyên và cập nhật phiên bản.

Trường hợp ứng dụng thực tế của Zeabur AI

Triển khai API chatbot AI, dịch vụ RAG/nhúng vector và dashboard phân tích dữ liệu; chạy backend Node/Python kèm frontend Next.js/React và cơ sở dữ liệu chỉ trong một cụm dịch vụ; dựng trang marketing, landing page và form thu thập dữ liệu có CI/CD liền mạch; vận hành microservices thương mại điện tử, thanh toán, thông báo; thiết lập môi trường staging/production tách biệt cho nhóm phát triển.

Gói cước và mô hình giá của Zeabur AI

Zeabur AI áp dụng mô hình pay‑as‑you‑go, tính phí theo mức tiêu thụ tài nguyên (CPU, RAM, lưu trữ, băng thông) và dịch vụ đi kèm. Người dùng có thể chọn shared clusters để tối ưu chi phí hoặc VPS hosting cho tài nguyên chuyên dụng và hiệu năng ổn định. Domain tùy chỉnh, bộ nhớ đối tượng và các tiện ích được quản lý tập trung, giúp theo dõi và kiểm soát ngân sách dễ dàng.

Ưu điểm và nhược điểm của Zeabur AI

Ưu điểm:

- Triển khai nhanh, quy trình đơn giản, giảm thời gian cấu hình hạ tầng.

- Tự động phân tích mã và hỗ trợ đa ngôn ngữ, đa framework, đa cơ sở dữ liệu.

- CI/CD và auto-scaling tích hợp giúp vận hành ổn định, linh hoạt.

- Gom nhóm dịch vụ, quản lý domain, biến môi trường, tệp và object storage đồng bộ.

- Mô hình tính phí theo dùng, linh hoạt giữa shared cluster và VPS.

Nhược điểm:

- Shared cluster có thể giới hạn hiệu năng ở tải cao so với VPS chuyên dụng.

- Cần thời gian làm quen cho các cấu hình nâng cao hoặc kiến trúc phức tạp.

- Chi phí có thể khó dự đoán khi auto-scaling tăng mạnh theo lưu lượng.

- Phụ thuộc nền tảng (vendor lock‑in) nếu tích hợp sâu vào hệ sinh thái riêng.

Các câu hỏi thường gặp về Zeabur AI

-

Câu hỏi:

Zeabur AI khác gì so với PaaS truyền thống?

Trả lời:

Zeabur AI tối ưu cho kỷ nguyên AI với phân tích mã tự động, triển khai mã do LLM tạo, gom nhóm dịch vụ và auto-scaling tích hợp, giúp rút ngắn thời gian từ mã nguồn đến sản phẩm.

-

Câu hỏi:

Zeabur AI có hỗ trợ CI/CD không?

Trả lời:

Có. Nền tảng tích hợp CI/CD để tự động build, test và deploy khi có thay đổi trên kho mã, hỗ trợ quy trình phát hành liên tục.

-

Câu hỏi:

Có thể triển khai backend, frontend và database cùng lúc?

Trả lời:

Có. Tính năng service aggregation cho phép kết nối nhiều dịch vụ (frontend, backend, cơ sở dữ liệu, object storage) trong một hệ thống thống nhất.

-

Câu hỏi:

Zeabur AI tính phí như thế nào?

Trả lời:

Áp dụng pay‑as‑you‑go dựa trên tài nguyên và dịch vụ sử dụng; có tùy chọn shared cluster tiết kiệm hoặc VPS chuyên dụng cho hiệu năng ổn định.

-

Câu hỏi:

Zeabur AI có hỗ trợ quản lý domain và SSL không?

Trả lời:

Có. Bạn có thể gắn domain tùy chỉnh, cấu hình DNS và cấp phát SSL tự động trực tiếp trong bảng điều khiển.

-

Câu hỏi:

Làm sao quản lý biến môi trường và bí mật?

Trả lời:

Nền tảng cung cấp quản lý biến môi trường tập trung, hỗ trợ chia sẻ an toàn giữa các dịch vụ và phiên bản hóa khi triển khai.

-

Câu hỏi:

Zeabur AI có phù hợp với dự án AI/ML?

Trả lời:

Rất phù hợp. Bạn có thể triển khai nhanh API mô hình, chatbot, RAG và các dịch vụ do LLM tạo ra, đồng thời mở rộng tự động theo tải.