- ホーム

- AI画像説明ジェネレーター

- Synexa

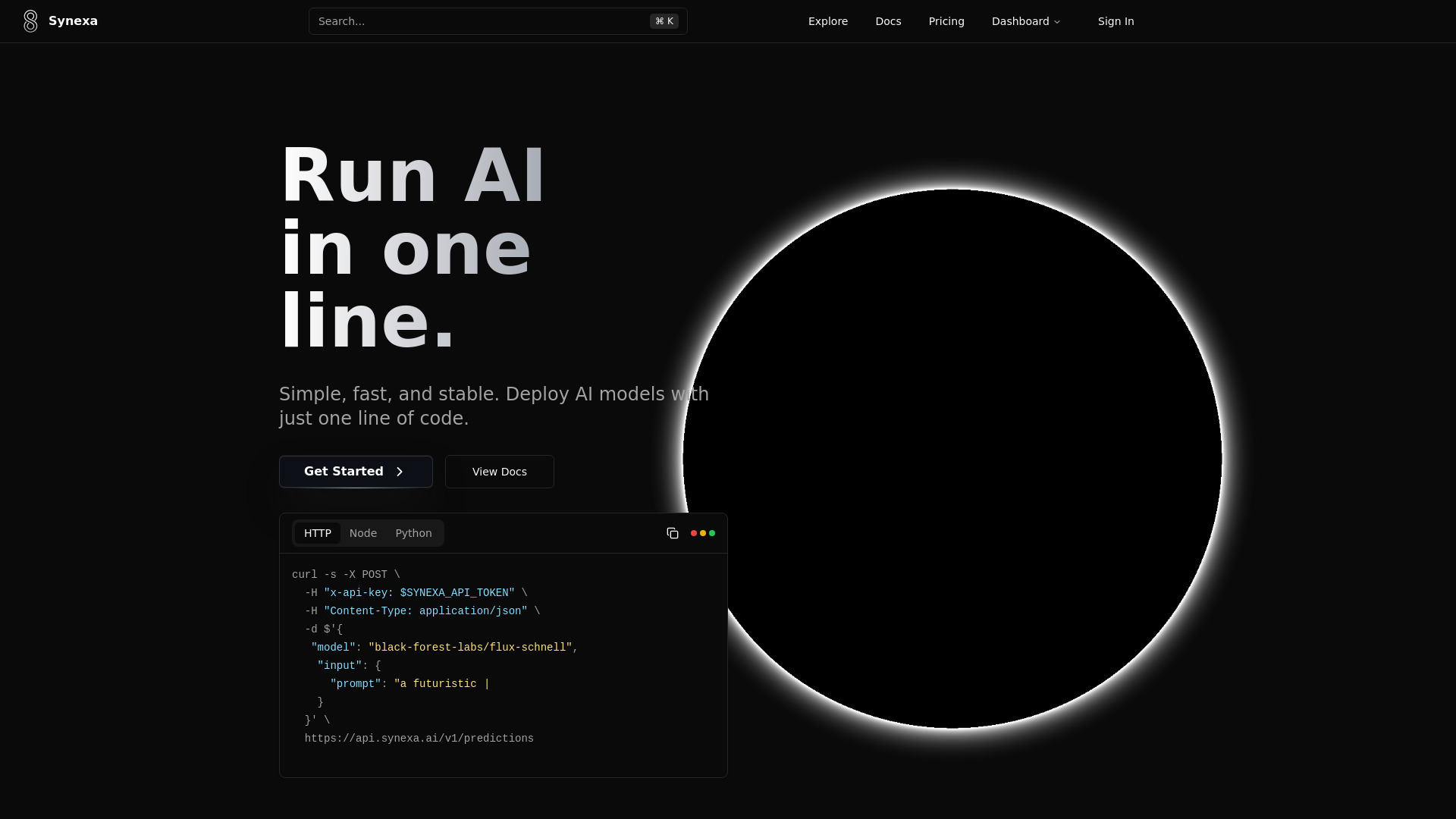

Synexa

ウェブサイトを開く-

ツール紹介:Synexa AIは1行ですぐ稼働、100+モデル運用。開発者向け、高速推論、安定自動スケール、低コストGPU。

-

登録日:2025-10-28

-

ソーシャルメディアとメール:

ツール情報

Synexa AIとは?

Synexa AI は、AIのデプロイとインフラ運用を統合したプラットフォームで、強力なAIモデルを1行のコードで即時に実行できる点が特長です。高速・安定・開発者フレンドリーを掲げ、推論を支えるエンジンはきわめて高速。用途に応じたモデル選択から本番運用までを短時間で進められるよう設計されています。コスト効率のよいGPUプライシングと自動スケーリングにより、負荷の波に応じてリソースを最適化しつつ、過剰なインフラ管理を抑制します。さらに、100以上のプロダクション対応モデルにアクセスでき、チャット、テキスト、画像、音声など多様なワークロードをカバー。APIやSDKからのシンプルな呼び出しを中心に既存システムにも組み込みやすく、スケールとレイテンシのトレードオフを抑えつつ開発サイクルを加速したいチームに適した基盤です。

Synexa AIの主な機能

- 1行のコードでモデルを呼び出せる簡潔なインターフェース(API/SDK主体の統合)

- 推論処理に最適化された高速エンジンによる低レイテンシな応答

- 需要に応じて自動で拡張・縮小するオートスケーリング

- コスト効率の高いGPUプライシングにより運用コストを最適化

- 100以上の本番運用可能なAIモデルへのアクセス

- 開発者体験を重視した設計で、迅速なプロトタイピングから本番移行までを支援

Synexa AIの対象ユーザー

Synexa AI は、短期間でAI機能をサービスに組み込みたいスタートアップから、安定したスケールとコスト最適化を求めるエンタープライズまで幅広く適しています。機械学習エンジニアやデータサイエンティストはもちろん、バックエンド開発者やプロダクトマネージャーにとっても扱いやすく、チャットボット、テキスト要約、画像解析、音声処理などのAI推論を安定運用したいWeb・モバイル・SaaSの利用シーンに向いています。

Synexa AIの使い方

- アカウントを作成し、開発環境から利用するためのAPIキーを取得します。

- モデルカタログから目的に合ったAIモデルを選択します。

- ドキュメントに沿って依存パッケージ(SDKなど)を導入し、1行のコードで推論を呼び出す最小実装を行います。

- 必要に応じて入力形式や推論パラメータを設定し、期待する応答を確認します。

- 本番環境に組み込み、トラフィックに応じた自動スケーリングの下で運用します。

- 応答時間やコストを観察し、モデル選定や呼び出し頻度を調整して最適化します。

Synexa AIの業界での活用事例

カスタマーサポートでは、対話型エージェントによる問い合わせ対応や要約の自動化に活用できます。コンテンツ分野では、文章生成や構成支援、校正のワークフローに組み込み、制作スループットの向上に寄与します。製造・小売では、画像分類や欠陥検知による検査効率化、在庫画像の認識で商品検索体験を改善。メディア・通信では、音声文字起こしや多言語の内容理解により業務の自動化を推進します。いずれも高速推論と自動スケーリングを活かし、ピーク時でも安定した体験を提供できます。

Synexa AIの料金プラン

Synexa AI は、コスト効率の高いGPUプライシングを重視した設計で、必要な計算資源を必要な分だけ活用しやすいのが特徴です。自動スケーリングにより過剰なリソースを抱え込むリスクを抑え、プロジェクト規模に応じたコスト管理を実現しやすくなります。具体的な料金や提供オプションは変更される可能性があるため、最新情報は公式の案内を確認してください。

Synexa AIのメリットとデメリット

メリット:

- 最小実装で動かせるため導入が速い(1行のコードで実行)

- 高速な推論エンジンにより低レイテンシを実現

- 自動スケーリングでトラフィック変動に強い

- コスト効率のよいGPU課金で運用費を最適化しやすい

- 100以上の本番対応モデルにアクセスでき用途が広い

- 開発者フレンドリーな設計でプロトタイプから本番まで一貫して扱いやすい

デメリット:

- クラウド基盤に依存するため、オンプレミス前提の要件とは合致しない場合がある

- 極めて細かな環境やモデルのカスタマイズには制約が生じる可能性がある

- ネットワーク環境によりレイテンシが影響を受ける場合がある

- データ取り扱いのポリシーやコンプライアンス要件は事前の精査が必要

Synexa AIに関するよくある質問

-

質問: Synexa AI は何ができますか?

AIモデルのデプロイと推論を迅速に行い、1行のコードで本番運用レベルのモデルを呼び出せます。高速・安定な推論と自動スケーリングが特徴です。

-

質問: どのようなモデルが利用できますか?

100以上のプロダクション対応モデルにアクセスでき、テキスト、画像、音声など多様なタスクをカバーします。

-

質問: スケールは自動で行われますか?

はい。需要に応じて自動スケーリングが働き、ピーク時でも安定した推論を提供します。

-

質問: 導入はどのくらい簡単ですか?

API/SDKを導入し、1行のコードで推論を呼び出すだけで基本動作を開始できます。

-

質問: 料金の考え方は?

コスト効率の高いGPUプライシングを採用しています。具体的な料金は公式の最新情報をご確認ください。