- Accueil

- Vérificateur AI

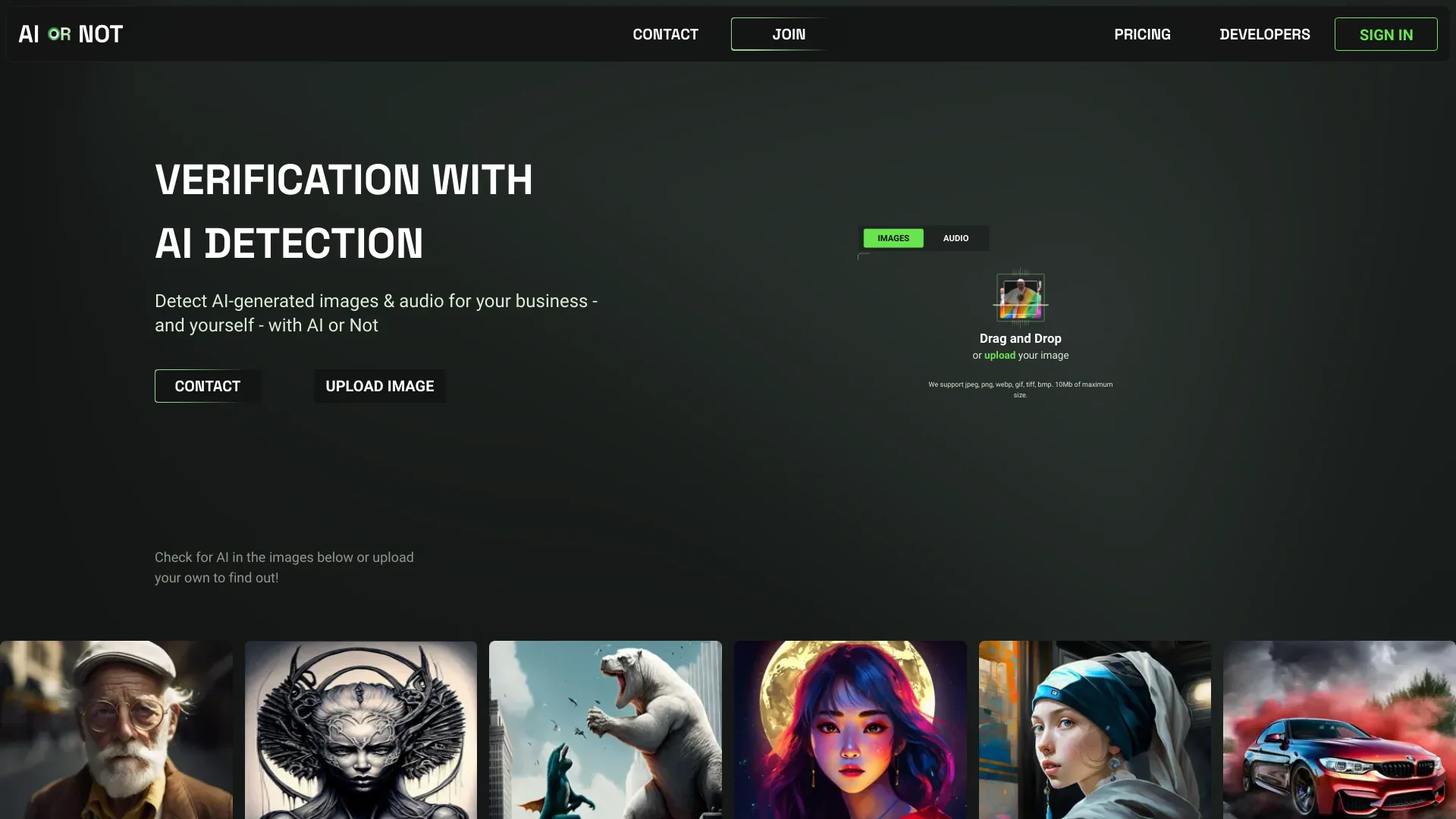

- AI or Not

AI or Not

Site web ouvert-

Présentation de l'outil:AI or Not détecte l’IA dans images, audio et KYC pour prévenir la fraude.

-

Date d'inclusion:2025-10-28

-

Réseaux sociaux et e-mails:

Informations sur l'outil

Qu’est-ce que AI or Not

AI or Not est un détecteur d’IA conçu pour estimer si un contenu a été généré par un modèle d’intelligence artificielle. Adopté par plus de 100 000 utilisateurs, il analyse des images, des fichiers audio et des documents d’identité KYC afin d’aider les entreprises à stopper la fraude, fiabiliser la modération de contenu et prévenir les usurpations lors de l’onboarding. En délivrant des scores clairs et des signaux exploitables, AI or Not facilite les décisions opérationnelles et renforce la confiance sur les plateformes numériques.

Fonctionnalités principales de AI or Not

- Détection multimodale : analyse des images, de l’audio et des documents d’identité KYC pour identifier les contenus générés ou altérés par IA.

- Scores de probabilité : attribution d’indicateurs qui orientent la décision (validation, refus, revue manuelle).

- Prévention de la fraude : repérage de contenus synthétiques et d’usurpations utilisées dans les parcours KYC.

- Modération de contenu : aide à prioriser et à escalader les éléments suspects sur les plateformes UGC.

- Adapté aux volumes : conçu pour traiter de larges flux et standardiser les contrôles à l’échelle.

- Intégration aux processus : s’insère dans les workflows et politiques internes existants pour réduire les frictions.

À qui s’adresse AI or Not

AI or Not s’adresse aux équipes fraude, conformité/KYC et trust & safety des banques, fintechs et plateformes numériques ; aux marketplaces et réseaux sociaux qui modèrent des contenus générés par les utilisateurs ; aux services juridiques et de sécurité des entreprises qui doivent vérifier l’authenticité de médias et de documents d’identité.

Comment utiliser AI or Not

- Définir le cas d’usage (KYC, modération, vérification média) et les seuils d’acceptation.

- Importer le contenu à vérifier (image, audio, document d’identité) dans le flux de contrôle.

- Lancer l’analyse et attendre la génération du score de probabilité.

- Consulter les signaux fournis et comparer au seuil défini.

- Appliquer l’action correspondante : valider, refuser ou escalader en revue humaine.

- Suivre les résultats et ajuster les règles de décision pour optimiser la précision opérationnelle.

Cas d’utilisation de AI or Not

Sur une plateforme UGC, prioriser la revue des images suspectées d’être synthétiques. En banque/fintech, renforcer le contrôle KYC lors de l’onboarding en repérant des documents d’identité générés ou altérés. Dans une place de marché, détecter des photos de produits artificielles pour limiter les annonces trompeuses. Pour des médias, vérifier l’authenticité d’audios et d’images avant publication afin de réduire les risques de désinformation.

Avantages et inconvénients de AI or Not

Avantages :

- Couverture multimodale (images, audio, documents d’identité KYC).

- Aide à la prévention de la fraude et à la modération de contenu.

- Scores clairs facilitant des décisions rapides et auditées.

- Approche adaptée aux volumes élevés et aux processus industriels.

- Adoption par une large base d’utilisateurs, gage de confiance du marché.

Inconvénients :

- Résultats probabilistes : nécessitent souvent une validation humaine.

- Performance sensible à la qualité des données (fichiers compressés ou altérés).

- Écosystème IA évolutif : de nouveaux modèles peuvent exiger des ajustements continus.

- Risque de faux positifs/négatifs à considérer dans les politiques internes.

Questions fréquentes sur AI or Not

-

AI or Not peut-il détecter les deepfakes ?

Il aide à repérer des signaux caractéristiques des contenus synthétiques dans l’image et l’audio ; les résultats restent probabilistes et doivent être combinés à une revue humaine pour les cas sensibles.

-

Quels types de contenus sont pris en charge ?

Les images, les fichiers audio et les documents d’identité utilisés dans les processus KYC, avec pour objectif d’identifier du contenu potentiellement généré ou manipulé par IA.

-

Le résultat est-il fiable à 100 % ?

Aucune solution n’est infaillible. Il est recommandé de définir des seuils, d’escalader les cas limites et de compléter par des contrôles manuels.

-

Comment l’intégrer à un flux KYC ?

Ajoutez un contrôle avant la validation finale : analyse du document, application d’un seuil de décision, et escalade automatique vers une vérification humaine si nécessaire.

-

Qu’en est-il de la confidentialité des données ?

Utilisez des pratiques de minimisation des données et consultez la documentation officielle de l’éditeur pour connaître les engagements de sécurité et de confidentialité applicables.